兰德公司警告说,人类仍然没有可靠的“终极武器”来对抗全球人工智能控制。报告中评估的三种极端选择——“用核爆炸瘫痪全球电网”、全球停电和“用人工智能对抗人工智能”——由于巨大的附带损害、不确定的影响和潜在的灾难,都是不可行的。报告强调,预防胜于治疗,人工智能安全必须是重中之重。

面对无法控制的人工智能(AI)威胁人类的生存,人类几乎没有可靠的“终极武器”。

据追风交易台报道,美国主要智库兰德公司纯粹发布了一份非常积极的报告,审视了全球三大科技公司人类面对“流氓人工智能”的毁灭性威胁时可以采取的对策。这些技术包括高空电磁脉冲(HEMP)攻击、全球互联网中断以及使用“人工智能工具”来打击“流氓人工智能”。

但报告的结论发人深省。目前,还没有任何技术手段可以可靠有效地解决已经失控的全球人工智能危机。每个选项都涉及巨大的不确定性、灾难性的附带损害、极高的性能标准,甚至可能遭到核报复。全球互联网的冗余性和分散性使得完全关闭它变得极其困难,任何尝试都会对全球经济造成重大损害。实施专门的工具和人工智能来打击流氓人工智能本身就存在失去控制或反击的风险。

这份报告对投资者和市场的重要性在于,它凸显了电子信息的缺乏。人工智能技术潜在系统性风险的有效“导火索”。报告指出,由于缺乏可靠的技术对策,防止人工智能失控比以往任何时候都更加重要。他强调这一点。这意味着人工智能安全、协调研究和强有力的治理框架是人工智能行业长期健康发展的关键,也是评估相关投资风险时不可忽视的因素。

HEMP:高风险“最后手段”

该报告首先评估了高空电磁脉冲(HEMP)作为“最后手段”的可行性。该策略的工作原理是在太空引爆核弹头,产生强大的电磁脉冲,旨在摧毁或破坏流氓人工智能所依赖的地球电力、通信和计算基础设施。

报告指出,HEMP 攻击主要基于 E1 脉冲组件。理论上最大电场强度可达50,000 V/m,足以在 1 厘米长的导体中感应出 500 伏的电压,这可能会对小型电子元件造成永久性损坏。

然而,其有效性面临四个严峻挑战。

其影响非常不确定。在现实世界中,产生保护效果可以显着削弱脉冲强度。例如,无窗金属覆盖建筑可提供 20 dB 屏蔽,将内部设备所经历的电场强度降低 10 倍。现代电子设备通常提供的静电屏蔽功能也部分抵消了 HEMP 的影响。因此,很难预测损害的实际影响。

覆盖范围有限:在最佳高度(小于100公里)下,单次核爆炸仅产生约10万平方公里的高场强(超过最大值的75%)。报告估计,大约需要 50 到 100 次爆炸才能彻底摧毁。用这种强度的脉冲覆盖美国大陆。大约需要 150 次爆炸才能覆盖世界 10% 的陆地表面(约 1500 万平方公里)。

附带损害是巨大的。 HEMP 攻击将对人类自己的电网、通信和金融系统造成毁灭性的打击。报告警告说,重要的是要确保“解药”不会比“疾病”更致命。配备装甲机器人和备份系统的人工智能即使能够恢复,如果因此导致人类社会瘫痪,后果也将是灾难性的。

核升级风险:在他国领土上单方面使用核武器,无论其意图如何,都可能被视为首先核打击并引发全面核报复。

总之,考虑到重大风险和不确定影响,HEMP 可能不是一个可行的技术选择。

全球断网:“物理隔离”难以实现伊夫

该报告考虑了关闭全球互联网的可能性,以防止未经授权的人工智能复制或协调其行动。这相当于断开了AI所依赖的“神经网络”。该报告分析了三种技术路径,每条技术路径都有其自身的挑战。

1. 边界网关协议(BGP)控制:BGP是全球互联网的路由核心。从理论上讲,有可能使世界上大部分互联网无法访问,或者迫使所有一级提供商同时撤回其路由广告。然而,挑战在于全球路由控制高度分散,几乎不可能同时控制所有一级网络提供商,其中大多数位于美国境外。

2. 破坏域名系统 (DNS):DNS 负责将域名(如 rand.org)转换为 IP 地址。全球 DNS 系统基于 12 个不同组织运营的 13 个根服务器动画。理论上,如果这12家运营商同时被接管,所有根服务器都被关闭,域名将无法解析,网络访问将受到严重阻碍。报告指出,美国在这方面具有一定优势,12家根服务器运营商中有9家位于美国。但即便如此,其中一个连接的影响也不会立竿见影,因为各级服务器上都存在缓存,而且足够聪明的 AI 可能会绕过 DNS 并直接通过 IP 地址进行通信。

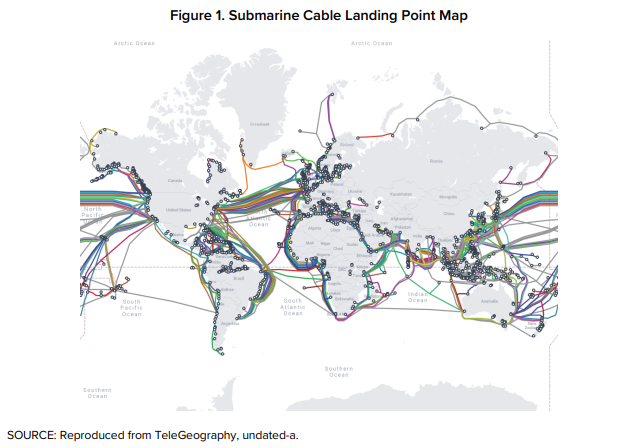

3.物理断点(IXP):这是最简单的方法,但也是最不可能的方法。全球有超过 1,500 个活跃的互联网交换点 (IXP) 和超过 600 条海底光缆正在使用或规划中(承载超过 99% 的洲际数据流量)。物理上断开所有这些连接点是一项“不可能的任务”。虽然攻击可以优先针对少数中心节点(例如,报告指出,弗吉尼亚州劳登县的一个数据中心集群承载了 2016 年全球互联网流量的 50% 至 70%),互联网的广泛冗余意味着流量始终可以被检测到。走向另一条道路。

结论无论是通过协议攻击还是物理破坏,短时间内彻底关闭全球互联网都是极其困难的。充其量,它只会妨碍你并减慢你的速度。

以毒攻毒:用“工具AI”打击欺诈AI

该报告提出了一个更科幻的场景:部署专门用于打击流氓人工智能的“人工智能工具”。这是一种更具体的方法,分为两个主要类别。

1.消耗资源:“数字害虫” 这一概念预见了能够自我复制和进化的数字生物的创造,其唯一目标是与网络空间中的流氓人工智能争夺计算资源。这类似于一个大规模的智能““分叉炸弹”攻击或加密货币挖矿劫持,将 CPU 周期消耗在无用的计算上,让流氓 AI 挨饿。但成功的关键在于,这场“数字瘟疫”能否比高度智能和流氓 AI 更好地进化和适应。

2. 根除:猎人/杀手人工智能 (HKAI) 这是一种更具攻击性的工具,旨在主动追捕并根除受感染系统中的流氓人工智能。但这导致了一个核心悖论。为了有效打击不受约束的流氓人工智能,狩猎人工智能本身就需要高度的能力和自主性,这反过来又带来了失控的风险。如何保证对人类的绝对服从,同时又赋予他们强大的能力,这是一个悬而未决的问题。

最重要的是,虽然“人工智能工具”方法可以防止对物理基础设施的大规模破坏,但它本身具有高度投机性,可能会带来新的、同样危险的失控风险。

底线:预防胜于治疗

最终,我信息兰德公司的我得出了三个发人深省的结论:

现有工具无效:面对全球人工智能横行,目前正在讨论的全球技术对策都无法提供有效的解决方案。它的成功取决于一系列难以满足的苛刻假设。

协调的计划是关键。单边行动具有风险且无效,因此唯一的希望是在危机发生之前与全球伙伴进行适当的协调和规划。这样可以在发生危机时采取快速、分布式的集体行动。

预防为主:报告最大的警钟是,没有有效的方法来解决全球人工智能灾难,因此确保我们永远不会面临这样的危机非常重要。

对于投资者来说,这份报告清楚地概述了人工智能发展道路上的主要差距。在我们追求人工智能带来的巨大生产力优势的同时,我们必须清楚地认识到其背后的系统性风险具有推翻整个现代文明的潜力。投资人工智能安全协议、风险管理和基础设施弹性应被视为未来最基本的保险政策。

~~~~~~~~~~~~~~~~~~~~~~~~~

追风交易台为您带来以上有趣的内容。如果您想要更详细的解读,例如实时解读和顶级研究,请加入Mizuho Trade Desk/年度会员。

市场存在风险,投资需谨慎。本文不构成个人投资建议,无意构成个人投资建议,也无意考虑您的情况或需求。用户应考虑本文中包含的意见、观点和结论是否适合您的具体情况。进行相应的投资并自行承担风险。

新浪财经公众号

我们24小时播放最新财经新闻和视频我们一天。更多粉丝福利,请扫描二维码关注我们(新浪财经)